엔비디아의 다음 해자는 칩이 아니라 데이터 공정이다

공덕 프론트원에서 본 니모트론 데브데이, 그리고 오픈 모델 경쟁의 축이 옮겨가고 있다는 신호.

마포 공덕 디캠프 프론트원 1층에 엔비디아가 부스를 차렸다. 출근하는 빌딩이었다. 호기심에 1층을 들렀고, 그 자리에서 본 것은 GPU 회사가 만들어 가고 있는 또 다른 묶음이었다. 엔비디아가 서울에서 처음 연 니모트론 데브데이의 풍경이다.

니모트론은 엔비디아가 공개해 온 오픈 AI 모델 시리즈의 이름이다. 메타의 라마, 알리바바의 큐엔, 구글의 젬마와 같은 자리에 놓이는 모델이다. 그런데 행사장에서 들은 메시지의 무게는 모델 그 자체보다 그 주변에 있었다. 니모트론은 모델 한 개가 아니라 "오픈 패밀리"다. 모델, 데이터셋, 라이브러리, 리서치까지 통째로 묶여 공개되는 한 덩어리의 무엇이다.

이 한 덩어리를 가만히 들여다보면, 엔비디아가 GPU 회사를 넘어가려는 다음 자리가 보인다. 칩으로 시작해서 칩 위에서 도는 모든 것을 묶어 가는 회사. 그 묶음의 다음 매듭이 데이터 공정이다. 오픈 모델 경쟁의 축이 베이스 체크포인트 공개에서 데이터 파이프라인과 환경 설계로 옮겨가는 신호가 이 행사장에 있었다.

GPU 회사가 오픈 모델을 만드는 이유

엔비디아가 오픈 모델을 만드는 이유는 모델 그 자체로 돈을 벌기 위해서가 아니다. 모델을 만들기 위해서는 어떤 인프라가 필요한지를 자기가 먼저 보여주기 위해서다. 모델을 직접 설계해 봐야 학습에 필요한 GPU 구조, 메모리 대역폭, 분산 학습 시스템, 강화학습 환경 같은 것들을 다음 세대 하드웨어로 미리 그릴 수 있다. 모델은 결과물이 아니라 인프라 설계의 입력이다.

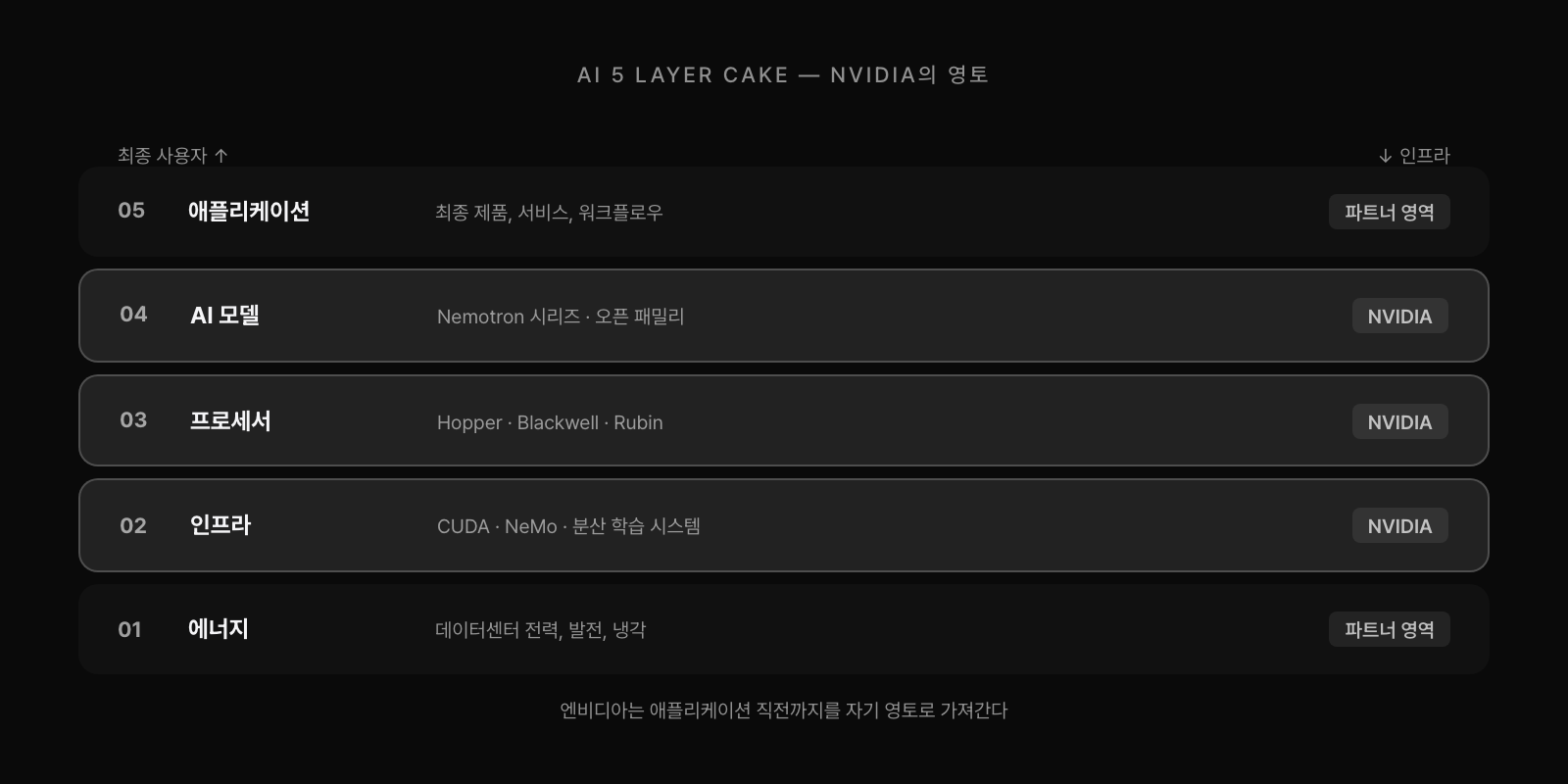

이것이 엔비디아가 자신을 GPU 회사가 아니라 "AI 팩토리의 OS 회사"라고 부르는 이유다. AI 팩토리라는 표현은 젠슨 황 CEO가 GTC에서 반복해 온 개념이다. 데이터를 받아 모델이라는 산출물을 찍어내는 공장. 그 공장의 OS를 만들겠다는 선언이다. OS는 칩, 시스템 소프트웨어, 모델, 데이터 공정, 강화학습 인프라까지 한 묶음으로 정의된다. 행사장에서 비유로 등장한 "AI 5 레이어 케이크"가 이 묶음의 다른 이름이다. 에너지, 인프라, 프로세서, AI 모델, 그리고 그 위의 애플리케이션. 엔비디아는 애플리케이션 직전까지를 자기 영토로 가져간다.

같은 패턴이 이미 한 번 작동했다. 쿠다다. 엔비디아가 GPU 위에 쿠다라는 개발 환경을 일찍 깔아두면서, 다른 칩 회사들이 따라오기 어려운 해자가 만들어졌다. 니모트론은 그 패턴의 AI 시대 재현으로 읽힌다. 모델, 데이터, 라이브러리, 리서치를 다 풀어 놓고 "이걸로 한번 해 봐라"고 던지는 방식. 그렇게 모인 개발자의 행위 데이터가 다음 세대 하드웨어와 다음 세대 모델을 설계하는 입력이 된다. 에코시스템은 한 번 잡히면 잘 빠지지 않는다. 쿠다가 그것을 증명했다.

좋은 모델보다 좋은 데이터가 희소해졌다

행사장에서 가장 무겁게 던져진 문장이 이것이었다. 좋은 모델보다 좋은 데이터가 희소해지고 있다. 인터넷에 데이터가 많아 보이지만, 프론티어 모델 학습에 바로 쓸 수 있는 고품질 데이터는 빠르게 소진되고 있다. 중복, 노이즈, 저작권, 개인정보가 섞여 있고, 무엇보다 모델이 새로 익혀야 할 능력의 데이터가 자연 상태에서는 발견되지 않는다. 검색을 잘하는 모델, 도구를 정확히 쓰는 모델, 장기 컨텍스트로 작업을 이어가는 에이전트의 행동 데이터는 인터넷에 흩어져 있지 않다.

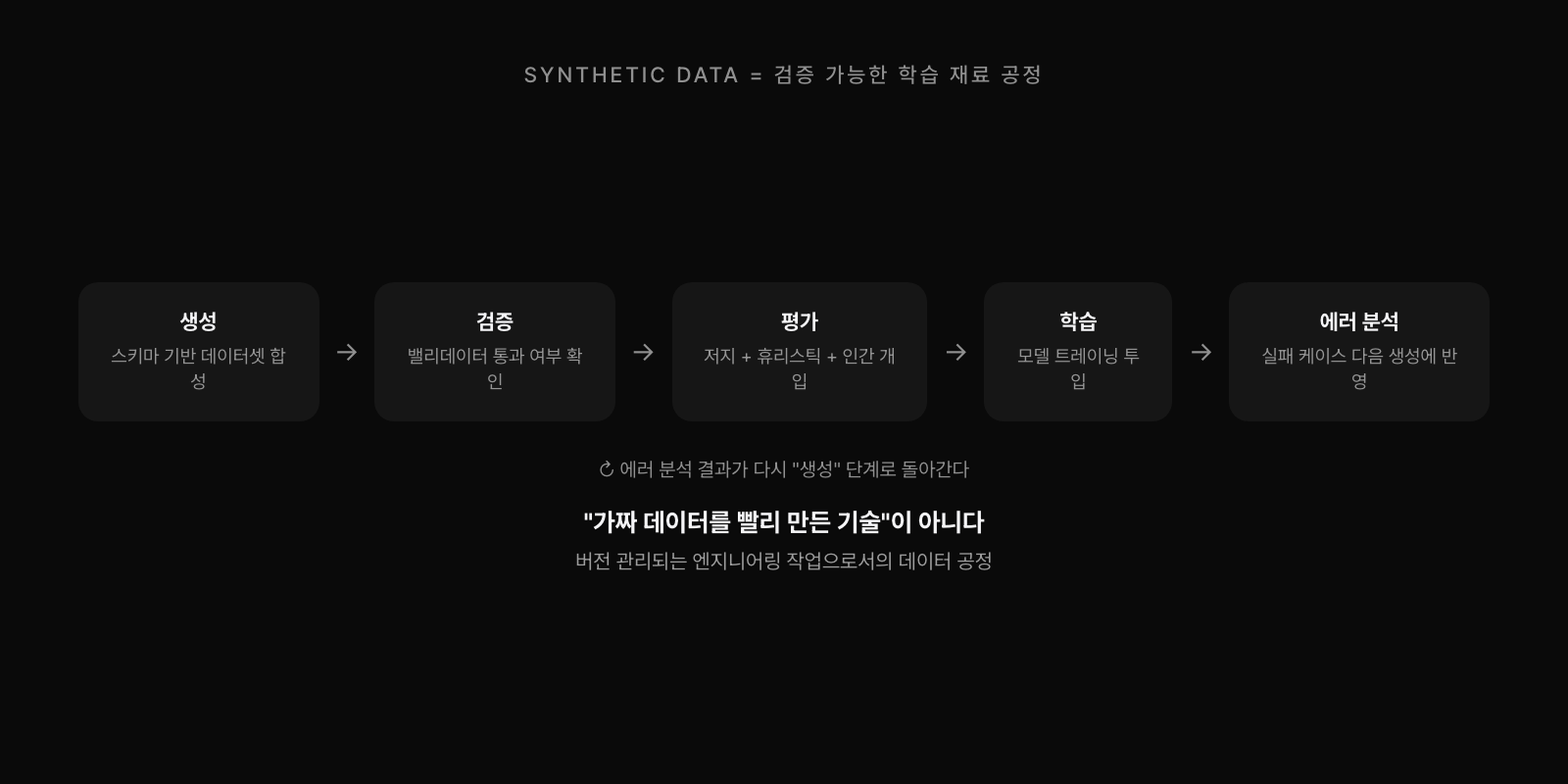

그래서 등장한 것이 합성 데이터다. 다만 행사장에서 강조된 합성 데이터는 흔히 알려진 "LLM으로 가짜 데이터 빨리 뽑기"가 아니었다. 그 뜻이라면 누구나 한다. 엔비디아가 말하는 합성 데이터는 검증 가능한 학습 재료로 설계되는 데이터다. 생성하는 단계, 검증하는 단계, 평가하는 단계, 인간이 개입하는 단계, 그리고 학습 과정에서 발생한 에러를 다시 입력으로 되돌리는 단계까지가 한 공정으로 묶여 있다. 합성 데이터는 텍스트 출력이 아니라 공정의 산출물이다.

이 공정을 도구화한 것이 니모 데이터 디자이너와 니모 큐레이터다. 데이터 디자이너는 파이썬 코드로 데이터셋의 스키마를 미리 정한다. 어떤 분포를 만들지, 어떤 다양성을 보장할지, 어떤 검증을 통과해야 학습 데이터가 될지를 코드로 선언해 두는 방식이다. 누구든 그 코드를 다시 돌리면 같은 데이터셋이 재생산된다. 큐레이터는 외부 데이터를 받아 정제, 분류, 중복 제거를 자동화한다. 데이터 생성이 프롬프트 노가다에서 버전 관리되는 엔지니어링 작업으로 옮겨가고 있다. 이 변화의 무게는 가볍지 않다. 데이터를 코드로 다룰 수 있느냐가 다음 시대 모델 회사의 격차가 된다.

모델은 챗봇이 아니라 에이전트로 학습된다

행사장에서 공개된 니모트론 3 슈퍼의 학습 데이터 분포를 보면 한 가지가 두드러진다. 에이전트형 행동, 도구 사용, 추론, 소프트웨어 엔지니어링이 데이터의 큰 부분을 차지한다. 채팅 응답을 잘 만드는 모델이 아니라 일을 하는 모델로 처음부터 설계되었다는 뜻이다. 이 점이 다른 오픈 모델들과의 차이를 만든다. 같은 파라미터 수의 모델이라도 어떤 분포의 데이터로 학습됐느냐에 따라 도달하는 능력의 종류가 달라진다.

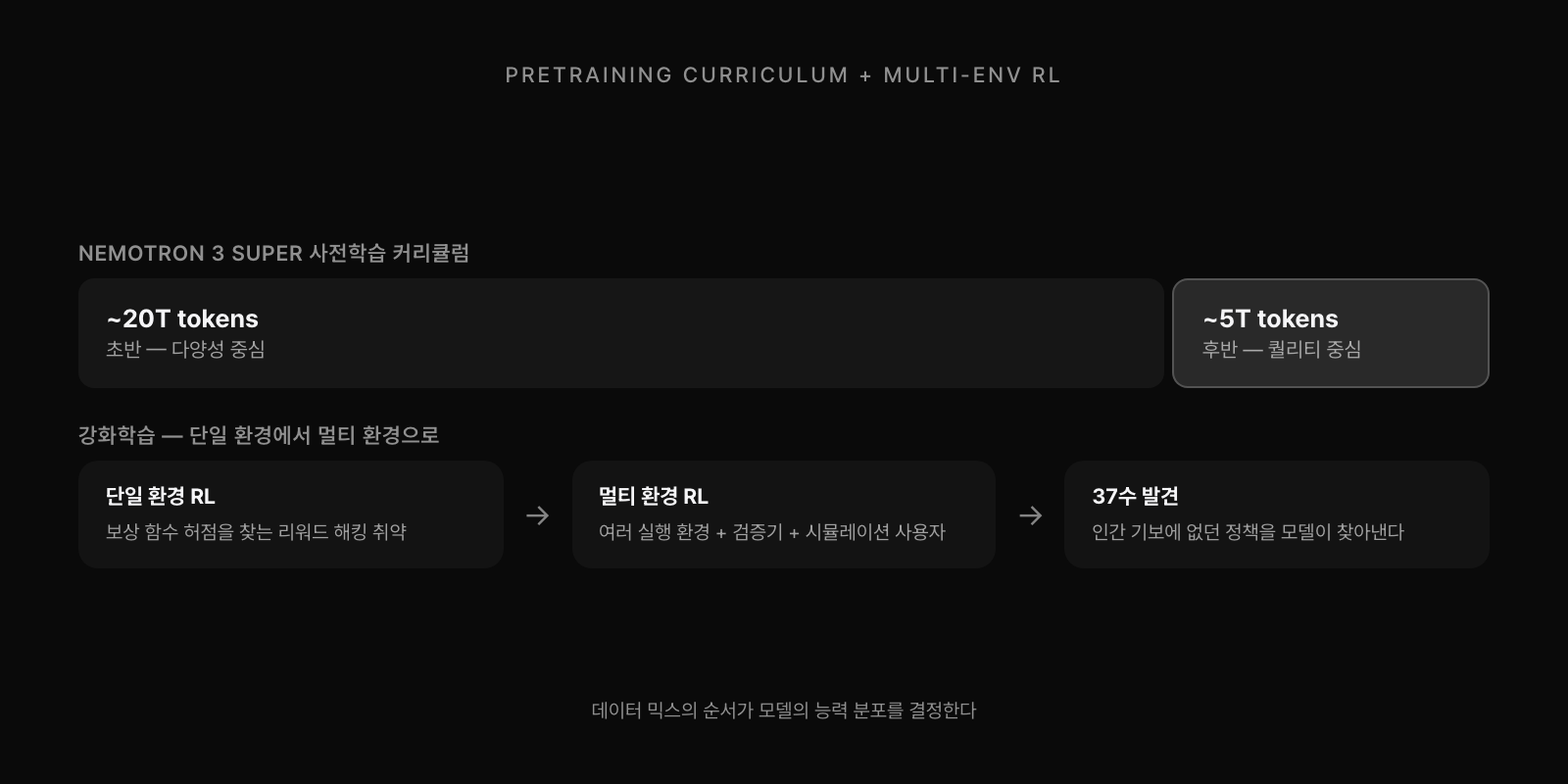

학습은 한 번에 던져지지 않는다. 커리큘럼이 있다. 니모트론 3 슈퍼의 경우 초반 약 20조 토큰은 다양성 중심으로 학습하고, 그 이후 약 5조 토큰은 퀄리티 중심으로 학습한다. 사람이 공부할 때 기초에서 응용으로 옮겨가는 순서와 닮아 있다. 무엇을 얼마만큼, 어떤 순서로 학습하느냐가 모델의 능력 분포를 결정한다. 모델 크기로 경쟁하던 시대가 데이터 믹스로 경쟁하는 시대로 옮겨갔다는 신호다.

강화학습 단계에서도 같은 이동이 일어난다. 단일 환경에서의 강화학습은 모델이 보상 함수의 허점을 찾아 가짜로 점수를 올리는 리워드 해킹에 취약하다. 그래서 엔비디아는 멀티 환경 강화학습으로 옮겨간다. 여러 실행 환경, 여러 검증기, 시뮬레이션 사용자까지 묶어 모델이 다양한 궤적을 따라 학습하도록 만든다. 알파고가 37수에서 인간 기보에 없던 수를 발견했듯이, 멀티 환경 강화학습은 모델이 인간이 미리 작성하지 않은 행동 정책을 발견하는 자리다. 이 환경 자체를 설계하는 일이 새로운 산업이 되고 있다.

한국이 데이터의 분포 안으로 들어와야 한다

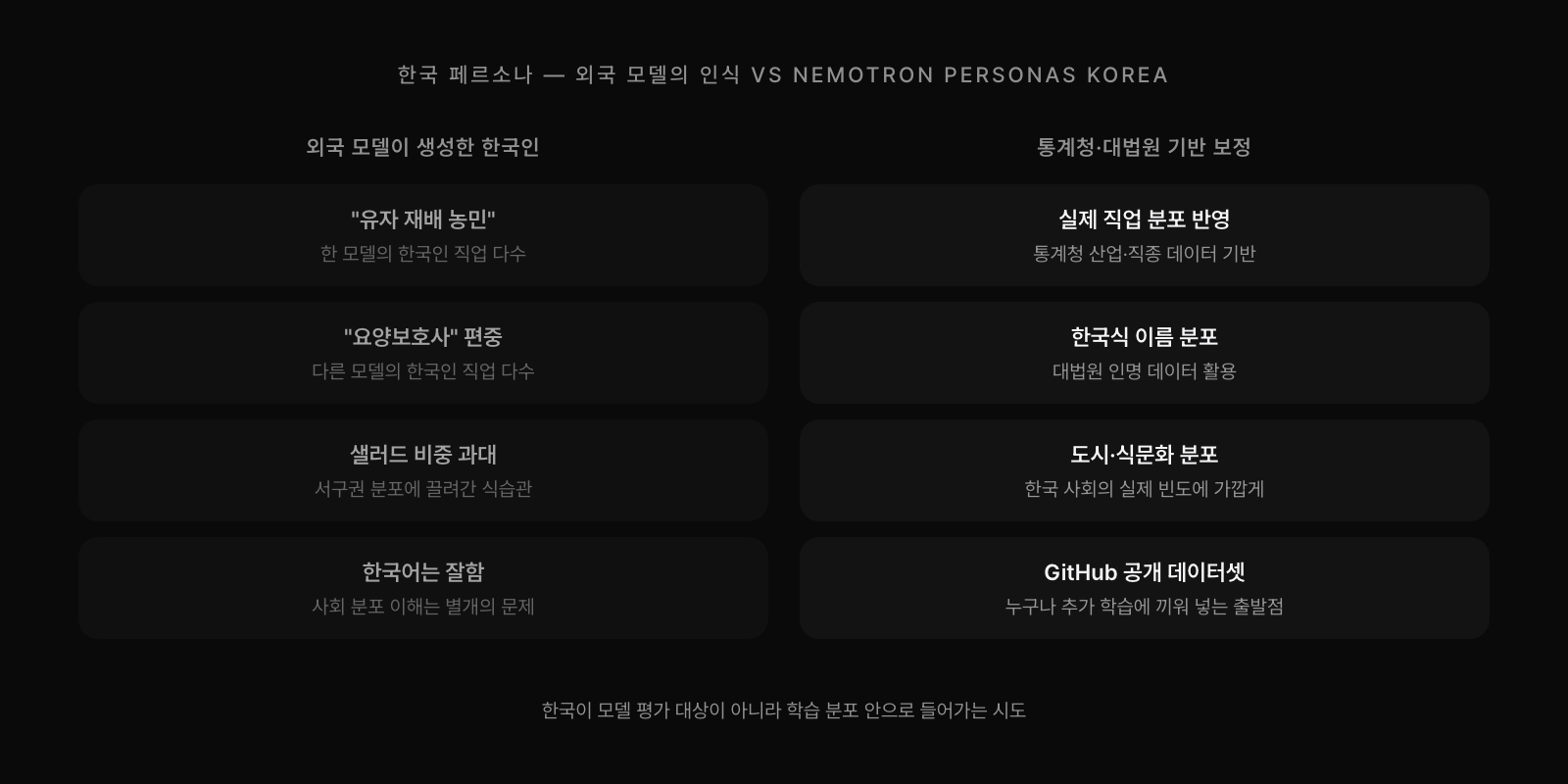

행사장에서 가장 인상적이었던 세션 중 하나가 니모트론 페르소나 코리아였다. 외국 모델이 한국인을 어떻게 인식하는지를 측정한 결과가 공개됐다. 한 모델이 한국인 페르소나를 생성하면 "유자 재배 농민"이 다수로 나오고, 다른 모델은 "요양보호사"를 다수로 뽑는다. 한국어를 잘하는 모델이라고 해서 한국 사회의 분포를 이해하는 것은 아니다. 두 능력은 다른 데이터에서 자란다.

이 어긋남은 환각의 한 형태다. 모델이 한국에 관한 질문을 받으면 자기가 학습한 분포 안에서 답을 만들어낸다. 그 분포가 서구권 데이터 위주로 짜여 있다면, 한국 직업의 빈도, 도시의 분포, 식습관, 문화적 뉘앙스에 대한 답은 통계청에서 본 한국과 다르게 나온다. 한국에 관한 답이 영어로는 자연스럽게 들리지만 한국인이 보면 어색한 이유가 여기에 있다.

니모트론 페르소나스 코리아는 통계청, 대법원, 그리고 한국 사회를 보여주는 여러 공공 데이터를 학습 재료로 묶은 데이터셋이다. 이름의 분포, 직업의 분포, 도시의 분포, 음식의 분포가 한국의 실제 분포에 가깝게 보정된다. 깃허브에 공개되어 있어 누구나 자기 모델 학습에 끼워 넣을 수 있다. 데이터셋이 공개됐다는 사실 그 자체보다 중요한 것은 그 다음이다. 이 데이터셋이 다른 한국 도메인의 분포 데이터를 만드는 출발점이 된다는 점이다. 한국이 모델의 평가 대상이 아니라 모델이 학습하는 분포 안으로 들어가는 시도다.

다시 그어야 할 오픈 모델 경쟁의 축

행사장을 나오면서 한 가지가 분명해졌다. 오픈 모델 경쟁의 축이 더 이상 베이스 체크포인트 공개에 있지 않다는 점이다. 라마가 처음 공개됐을 때 "웨이트를 풀었다"는 사실 그 자체가 이슈였다. 지금은 다르다. 합성 데이터를 어떤 공정으로 만드는가, 데이터 믹스를 어떻게 짜는가, 멀티 환경 강화학습을 어디까지 구축했는가, 그리고 그 모든 것을 어느 국가의 도메인까지 확장하는가가 새로운 경쟁 축이다.

이 축의 이동은 엔비디아 같은 회사에 유리하게 작동한다. 데이터 공정과 강화학습 환경 구축은 단일 모델 학습보다 훨씬 더 큰 인프라를 요구한다. GPU, 분산 시스템, 시뮬레이션 환경, 평가 파이프라인까지 한 묶음으로 갖춰야 가능한 일이다. 엔비디아는 이 묶음을 이미 갖고 있다. 자기 인프라로 자기 모델을 만들고, 자기 모델로 자기 인프라의 다음 세대를 설계한다. 이 순환 자체가 해자다.

물론 합성 데이터가 만능이라고 보기는 어렵다. 현실의 분포는 언제나 합성으로 다 잡히지 않는다. 그래서 페르소나 데이터셋처럼 로컬 도메인의 데이터를 끌어들이는 작업이 함께 가야 한다. 결국 다음 시대 오픈 모델의 경쟁은 데이터의 폭과 분포, 그리고 그 분포를 다루는 공정의 정교함에서 갈린다. 엔비디아가 칩으로 시작해서 데이터 공정으로 향하고 있는 이유가 그것이다. 다음 해자는 칩이 아니라 그 공정 안에 그어지고 있다.